回归

连续监督学习

- 连续输出和离散输出的区别

这里的连续主要是指输出是连续的

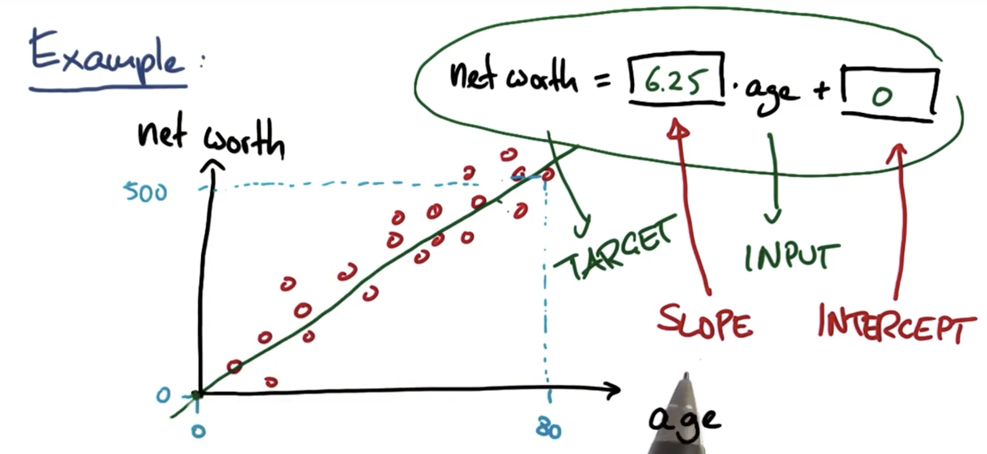

回归线性方程

slope:斜率

intercept:截距

斜率和截距

斜率越大,上升越快

Sklearn中的线形拟合

|

|

线性回归误差

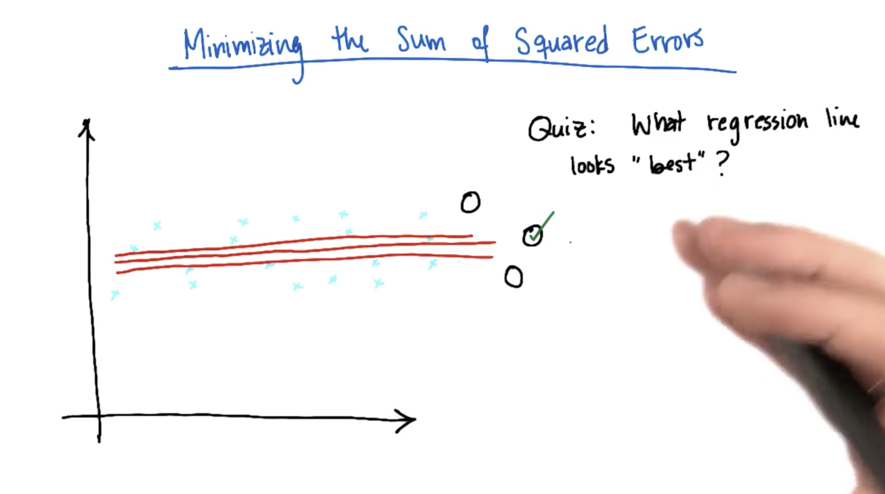

使误差有最小值。

最小二乘法(OLS)

sklearn中的线性拟合即使用的是该方法

|

|

使用平方误差和来评估拟合的效果?

如上图所示,如果只是使用绝对值,那么途中的3种拟合方式没有什么区别,然而如果使用平方的方式,只有中间的误差是最小的。

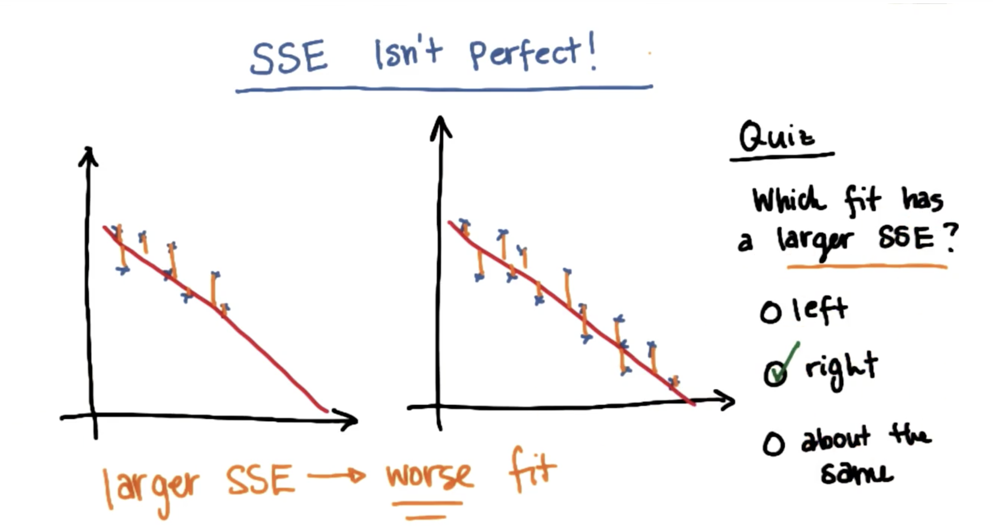

- 使用平方误差和的方式的不足只处

R平方指标

R平方指标弥补了平方误差和的不足之处。

梯度下降法

什么数据适用于线性回归

线性的,可以拟合成

$$

y = ax + b

$$

回归于分类的比较

| 比较 | 监督分类 | 回归 |

| 输出类型 | 离散(类型标签) | 连续(数字) |

| 目的 | 找到决策边界 | 最优拟合线 |

| 评估指标 | 准确率 | R平方值 |